|

Test de Turing |

|

|

|

|

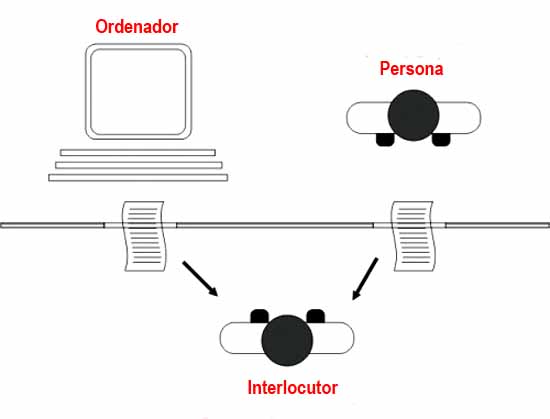

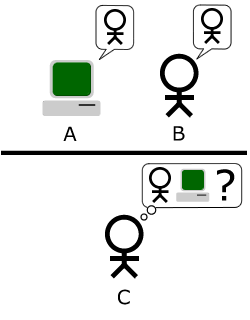

| Alan Turing (1912-1954) fue matemático, criptógrafo, filósofo y un teórico de la computación. Trabajó en el equipo que descifró los códigos Enigma de Alemania en la IIª Guerra Mundial. En 1950 publicó un importante artículo considerado como uno de los puntos de arranque de la llamada inteligencia artificial (IA), Computing Machinery and Intelligence, donde propuso un experimento: el llamado Test de Turing. Este artículo comenzaba con una frase célebre: Propongo considerar la siguiente cuestión: ¿Pueden pensar las máquinas? El test se basa en una hipótesis: si una máquina se comporta en todos los aspectos como inteligente, entonces, dicha máquina debe ser inteligente. Como las personas pensamos hablando, propuso un test tripartito, con un juez que conversa a través de una pantalla con dos interlocutores, uno es persona oculta y el otro es un programa de ordenador. El juez no sabe quién es quién. El ordenador supera el test si su conversación es tan fluida que el juez no es capaz de saber cuál de sus dos interlocutores es la persona. |

|

|

| Desde el año 1991 hay una competición anual de test de Turing, el premio Loebner, que está dotado con 100.000 dólares para el programa que engañe a los jueces en el 100% de las conversaciones. Hasta ahora nadie ha ganado el premio. La primera vez que un juez confundió a un programa de ordenador con una persona fue en el año 2010, con el chatbot Suzette, de Bruce Wilcox. En el año 2012, el chatbot Eugene Gostman, engañó a los jueces en el 29% de las conversaciones y este año, 2014, el 60 aniversario de la muerte de Turing, ha vuelto a ser noticia el chatbot Eugene al engañar a los jueces en el 33% de las conversaciones. Todavía se está lejos de alcanzar un 100% y recibir el gran premio. |

|

|

| Aunque la inteligencia artificial pasó décadas de "momentos bajos", últimamente las innovaciones tecnológicas, especialmente la posibilidad de almacenar vastas cantidades de información y procesarlas a gran velocidad, han vuelto a poner la pregunta en el disparadero. Hay campos en los que se ha pasado de la teoría a cosas más prácticas. |

|

Los creadores de videojuegos están acostumbrados a crear "inteligencias artificiales" para los personajes de los juegos que compiten contra los humanos. En las salas de "póker online" existe una gran controversia sobre jugadores y casinos que utilizan bots (programas informáticos que realiza funciones muy diversas, imitando el comportamiento humano) o robots jugadores. No sólo han de conocer las probabilidades del juego y seguir una buena estrategia de apuestas, también han de hacerlo de modo que no despierten sospechas, o el resto de clientes saldría de allí pitando. A diferencia del ajedrez o las damas, no hay todavía un programa que juegue al póker mejor que los humanos, ni está claro si esos robots se dedican también a despistar escribiendo comentarios en las pantallas del chat junto a la mesa de juego. |

|

Como no podía ser menos, la inteligencia artificial también ha tenido su lado oscuro. Hace tiempo se descubrió una creación llamada CyberLover que se hacía pasar por la "chica de los sueños" en algunas salas de chat sobre sexo. Los incautos que le seguían el juego acababan revelando datos personales: nombres, correos, información de contacto, fotos... y eran entonces guiados a sitios trampa donde los desplumaban. En la mayoría de las ocasiones, CyberLover era capaz de "enganchar" a sus indefensas víctimas en menos de diez minutos de conversación. Naturalmente, las víctimas no se lo esperaban. Eso está muy lejos de ser el test que propuesto Turing, pero la letal efectividad de esa inteligencia resulta sin duda inquietante. |

|

La caja china |

|

|

|

|

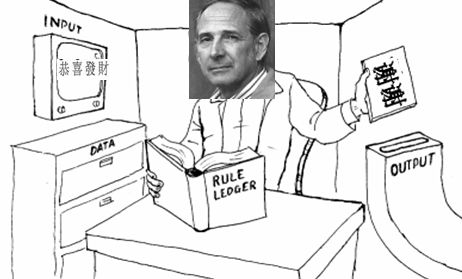

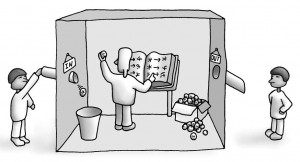

| La

"habitación china" es un experimento mental propuesto por John

Searle, y popularizado por Roger Penrose en su libro La nueva mente del emperador,

para rebatir la validez del Test de Turing y la creencia de que una

máquina puede llegar a pensar. Según Searle, el hecho

de que una máquina supere el test de Turing -es decir, que conteste

a las preguntas de un interrogador humano como lo haría una persona-

no significa que piense. Una puntualización importante: Searle no

niega que las máquinas puedan pensar -el cerebro es una máquina y

piensa-, niega que al hacerlo apliquen simplemente un programa,

porque la mente implica no sólo la manipulación de símbolos, sino

también una sintaxis y una semántica. Para demostrarlo planteó la siguiente situación hipotética: supongamos que el propio Searle se encierra en un cubículo aislado del exterior en el que, por una ranura, un observador que no sabe lo que hay dentro introduce preguntas en chino. Searle no sabe una palabra de ese idioma, pero, provisto de una serie de fichas con símbolos chinos y observando un determinado conjunto de reglas, podría escribir en un papel respuestas coherentes, en caracteres chinos, y hacerle creer al observador que el cubículo sabe chino, o que dentro hay alguien que conoce ese idioma. Análogamente, argumenta Searle, una máquina puede dar respuestas coherentes a preguntas humanas sin tener la menor conciencia de lo que está haciendo: basta con que posea el equivalente de un sistema de fichas lo suficientemente complejo y unas reglas combinatorias adecuadas. |

|

¿Y en el futuro? |

| El último candidato a superar la prueba podría ser ni más ni menos que un conocido de todos: Google. En un artículo titulado ¿Superará pronto Google el test de Turing? se examinaba la capacidad de buscadores de Internet como Google para «conocer» cada vez más respuestas a preguntas más y más complejas. Si ahora saben lo que la mayor parte de la gente responde a preguntas de cuatro o cinco palabras ("¿Dónde nace el río Ebro"?) en unos años podrían dar sin pestañear respuestas precisas a frases de diez, quince o más palabras. "¿Cómo saben mejor los espagueti carbonara: con nata o sin nata?". Muchos expertos consideran que en las próximas décadas veremos superar a las máquinas el famoso test ideado por Turing. Entonces tendremos que decidir si considerarlas inteligentes… o cambiar las reglas. |